從“手工作坊”到“現代工業” AI模型規模化量產的數據處理之道

在人工智能的浪潮中,AI模型的開發經歷了從“手工作坊”式的小規模實驗到“現代工業”式規模化量產的深刻轉型。這一轉型的核心驅動力與關鍵瓶頸,往往不在于算法本身的突破,而在于數據處理能力的系統性升級。要實現AI模型的規模化量產,數據處理必須完成從“匠人技藝”到“標準化流水線”的演進。

一、 “手工作坊”階段的困境:數據處理的原始狀態

在早期或小規模項目中,數據處理常呈現以下特征:

- 手動與臨時性:數據收集、清洗、標注嚴重依賴人工,流程隨意,缺乏標準化。如同工匠逐件打造,無法復制和擴展。

- 孤島與碎片化:數據分散在不同團隊、不同格式中,難以統一管理和利用,形成數據孤島。

- 質量不可控:數據標注質量參差不齊,清洗規則因人而異,導致模型訓練不穩定,結果難以復現。

- 效率瓶頸:處理海量數據時,人力與時間成本呈指數級增長,嚴重拖慢模型迭代速度。

這種模式無法支撐需要處理TB乃至PB級數據、頻繁迭代更新的工業化AI生產需求。

二、 邁向“現代工業”:規模化數據處理的核心支柱

要實現數據處理的工業化,必須構建四大核心支柱:

1. 自動化與標準化的數據流水線

這是規模化生產的“裝配線”。它意味著:

- 流水線作業:將數據采集、清洗、標注、驗證、版本管理、輸送至訓練集群等環節串聯成自動化流水線,減少人工干預。

- 標準化協議:為每種數據類型(如圖像、文本、語音)制定統一的數據格式、標注規范和質量標準,確保數據的一致性與可復用性。

- 工具平臺化:使用統一的數據管理平臺和標注工具,提升協作效率,并記錄完整的數據譜系,實現全流程可追溯。

2. 高質量與多樣化的數據供給體系

“原料”的質量與多樣性決定“產品”的上限。

- 智能數據清洗與增強:利用算法自動檢測并修復臟數據、缺失值,并運用數據增強技術(如旋轉、裁剪、合成)在保障質量的前提下擴充數據集多樣性。

- 合成數據與遷移學習:在真實數據稀缺或獲取成本高的領域(如自動駕駛、醫療),利用仿真引擎生成高質量的合成數據,或利用遷移學習借助相關領域數據,突破數據供給瓶頸。

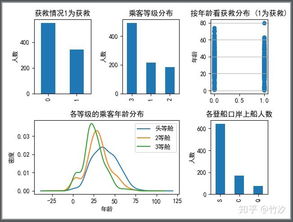

- 主動學習與數據閉環:讓模型自己“提出”哪些數據最難、最有價值(不確定性高),優先對這些數據進行標注和補充,形成“模型訓練->實際應用->收集新數據/困難樣本->再訓練”的自動優化閉環,持續提升數據效能。

3. 可擴展與高性能的底層架構

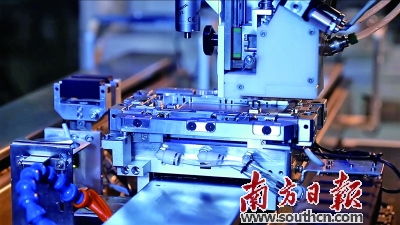

處理海量數據需要強大的“工業母機”。

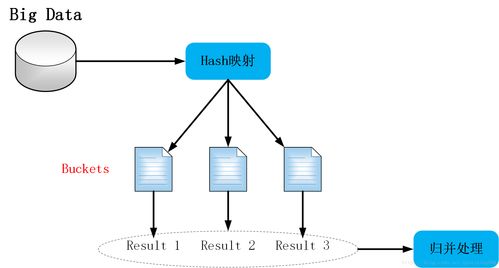

- 分布式存儲與計算:基于HDFS、云對象存儲等構建可彈性擴展的數據湖/倉庫,并利用Spark、Flink等分布式計算框架進行并行化預處理,應對海量數據吞吐。

- GPU加速與專用硬件:在數據預處理、增強等環節引入GPU加速,甚至使用專用AI芯片,大幅提升處理速度。

- 云原生與彈性調度:利用云平臺的彈性資源,按需動態調度計算和存儲資源,應對數據處理任務量的波峰波谷,實現成本與效率的最優平衡。

4. 系統化的質量監控與治理

工業化生產離不開嚴格的“質檢”與“管理”。

- 全鏈路監控:在數據流水線的每個環節設置質量檢查點,自動監控數據分布、標注一致性、異常值等關鍵指標。

- 版本控制與可復現性:像管理代碼一樣管理數據和數據處理代碼(如DVC工具),確保任何模型都能追溯到其訓練所用的精確數據版本與處理流程,實現完全復現。

- 偏見與公平性審計:系統化檢測訓練數據中可能存在的性別、種族、地域等偏見,并通過數據平衡、算法修正等手段加以緩解,確保量產模型的公平與可靠。

三、 未來展望:數據處理的持續進化

AI模型量產的競爭,本質上是數據工程能力的競爭。未來的數據處理將進一步向智能化、一體化演進:

- AI for Data:更廣泛地應用AI來自動化數據管理、質量評估、標簽生成乃至流水線優化本身。

- Data-Centric AI:工程重心從一味追求更復雜的模型架構,轉向持續、系統化地迭代和提升數據質量,這已成為行業共識。

- 無縫的MLOps集成:數據處理作為MLOps(機器學習運維)的核心一環,將與模型開發、訓練、部署、監控等流程更深地融合,形成端到端、自動化的AI生產體系。

###

從手工作坊到現代工業,AI模型規模化量產的實現,標志著人工智能從實驗室走向產業應用的成熟。在這一躍遷中,數據處理不再是輔助性的準備工作,而是決定產能、質量與效率的核心生產環節。只有建立起標準化、自動化、高質量、可擴展的數據處理體系,才能為AI的“大規模制造”提供源源不斷的優質“燃料”,真正釋放人工智能的工業潛力。

如若轉載,請注明出處:http://www.gzdazhongbj.com.cn/product/40.html

更新時間:2026-02-23 15:14:41